6. Peut-il y avoir un contrôle démocratique de l’IA ?

L’IA en questionsTemps de lecture : 3 minutes

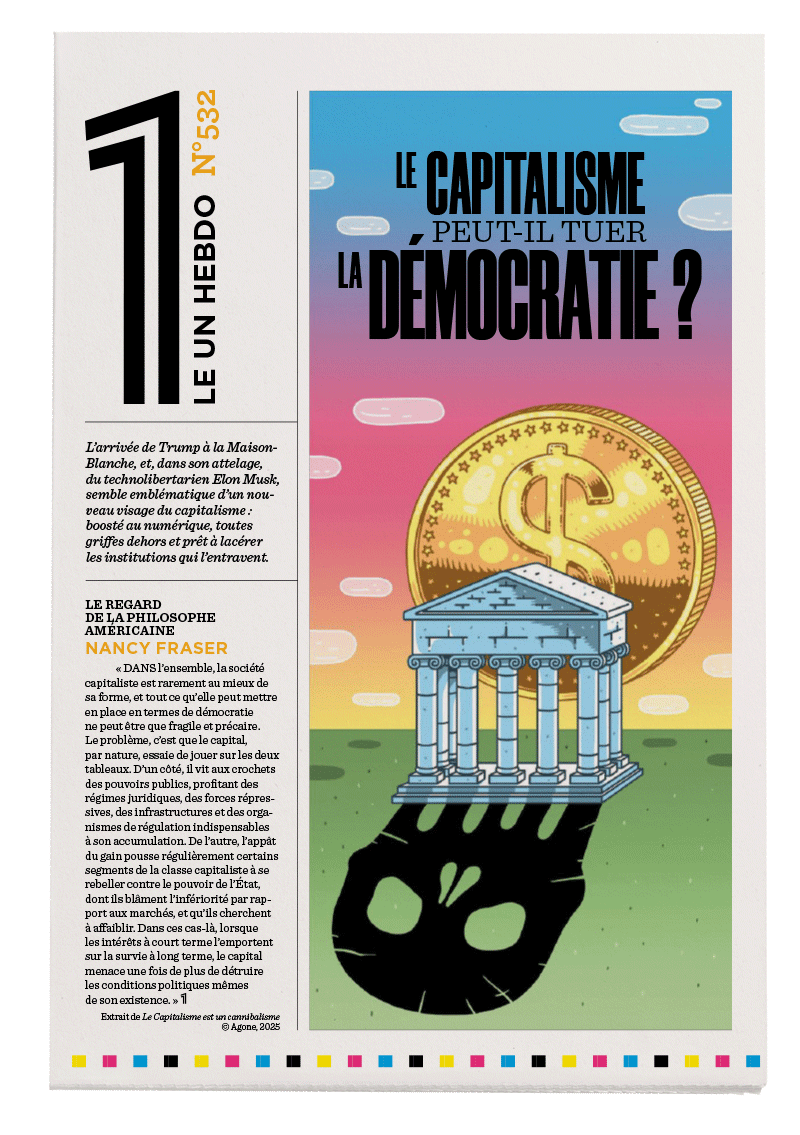

Comment faire en sorte que la société civile ne subisse pas les innovations technologiques, que les citoyens aient leur mot à dire sur l’adoption de telle ou telle technologie ? Un premier élément de réponse tient dans la démystification de la technologie, laquelle ne doit pas rester l’apanage des seuls experts. L’expérience montre que la construction d’un débat entre le public et les scientifiques peut être vertueuse, ouvrir des perspectives et inviter chacun à se positionner pour, demain, prendre ses responsabilités. La démocratie technologique demeure, dans une large mesure, à inventer. De véritables instances de médiation technologique, participant au processus institutionnel, font encore défaut.

Il est, de même, important de faire évoluer nos méthodes. L’introduction de l’IA dans nos services publics en est un bon exemple. Depuis de nombreuses années, la voix de l’expérimentation a été privilégiée. Elle présente des intérêts certains pour évaluer l’utilité pratique et technique des outils. Toutefois, ces expérimentations font rarement l’objet d’une évaluation proprement démocratique. Elles sont bien souvent pérennisées et élargies dans la plus grande opacité. Tel fut notamment le cas des outils de lutte contre la fraude sociale, ou du système d’affectation des étudiants. Leurs effets délétères pour les publics concernés ont été rendus publics ultérieurement, au terme d’enquêtes journalistiques ou de procès.

L’enjeu, ici, est celui de la redevabilité algorithmique : la manière dont une administration ou une entreprise rend compte de son usage de la technologie. Il est important de repenser les conditions dans lesquelles les « déployeurs » de l’IA assument les conséquences d’un dommage causé, mais aussi, plus largement, justifient d’un usage éthique et responsable en conformité avec la loi.

L’enjeu est celui de la redevabilité algorithmique : la manière dont une administration ou une entreprise rend compte de son usage de la technologie

L’expérimentation de la vidéosurveillance algorithmique à l’occasion des JO de Paris offre en ce sens un précédent intéressant. L’arrivée de technologies d’IA dans les espaces publics a rendu la problématique tout de suite très tangible. L’opinion publique a commencé à percevoir la menace. Nous ne sommes pas prêts à perdre notre anonymat dans l’espace public, nous dont la méfiance est nourrie aussi bien par un imaginaire fictionnel que par des exemples étrangers – du fameux score social chinois à l’usage à grande échelle de la reconnaissance faciale comme outil de contrôle et de répression dans des régimes autocratiques. Pour répondre aux inquiétudes, le législateur français a mis en place un comité d’évaluation indépendant, chargé de juger de l’efficacité du système, mais aussi des atteintes éventuelles aux libertés publiques. Nul ne peut prédire la portée de cette démarche et de ses conclusions, qui restent liées à la volonté politique. Sur le plan méthodologique, cela constitue cependant une avancée au service de l’instauration de contre-pouvoirs. Il nous faut multiplier et, idéalement, institutionnaliser les initiatives dans ce sens.

Enfin, le contrôle démocratique de l’IA implique de travailler avec l’ensemble des parties prenantes qui, aujourd’hui et demain, seront amenées à l’utiliser sur le terrain. Un usage responsable se construit aussi à l’échelon local et opérationnel. Cela implique de réfléchir aux environnements de travail dans lesquels ces outils sont introduits, de coconstruire des modèles responsables. Cela nécessite encore de former les agents, les employés qui doivent être familiarisés à la façon dont est conçue et appliquée l’IA et à ses enjeux éthiques pour mieux mitiger les risques qu’elle soulève. Il ne faut pas oublier que l’IA crée une distance par rapport à certaines dimensions de la réalité – pensons aux drones de combat. Tout l’enjeu est finalement, à l’ère des machines, de ne pas trop nous éloigner les uns des autres pour préserver l’empathie, nos compétences et, finalement, notre humanité.

Conversation avec LOU HÉLIOT

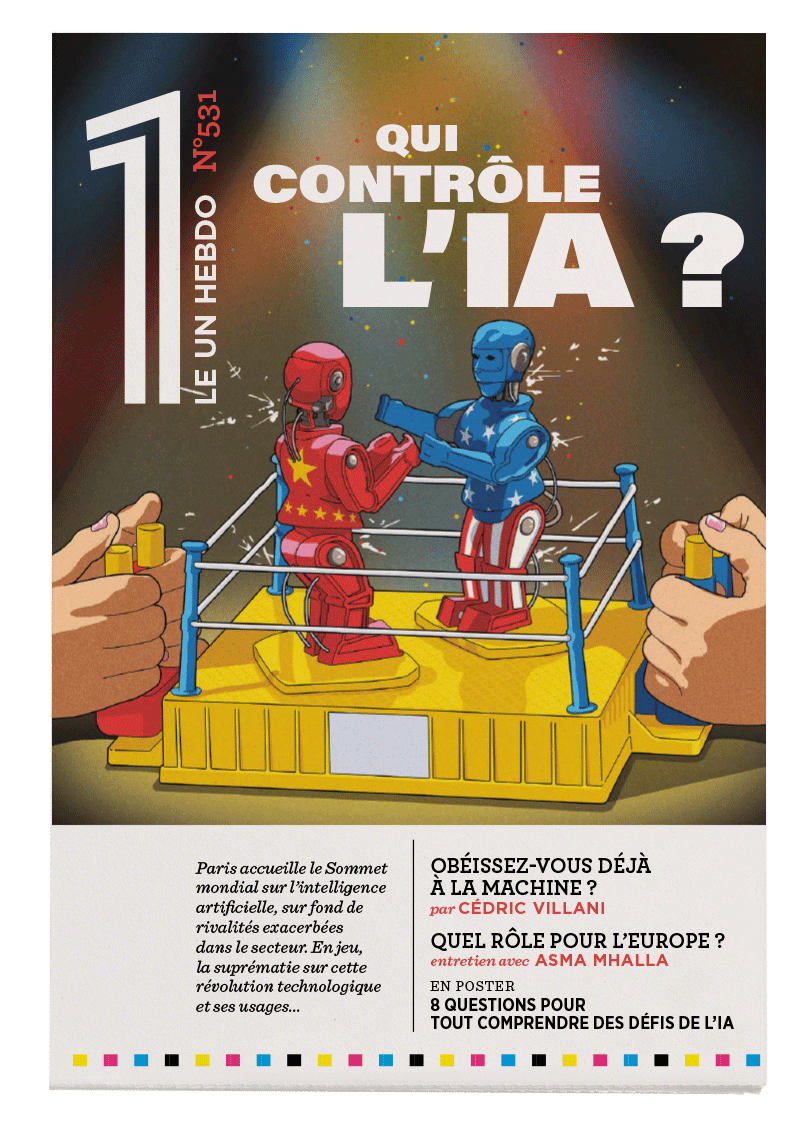

« Les États ne peuvent rien sans la Tech »

Asma Mhalla

La politiste Asma Mhalla dresse un tableau des grands enjeux géopolitiques suscités par l'IA, cette technologie qui a pris une place centrale dans la stratégie de puissance des États.

[Lia]

Robert Solé

JE M’ÉTAIS trompé sur son compte. L’IA (que j’appelle Lia dans l’intimité) n’est pas celle que je croyais...

La guerre automatisée

Laure Roucy-Rochegonde (de)

La politiste Laure De Roucy-Rochegonde revient sur la façon dont l’IA révolutionne le secteur militaire et reconfigure le problème du contrôle de la force en remettant en cause les règles traditionnelles.